서 언

재료 및 방법

사례 지역과 분석 데이터

다분광 인공위성과 분광 지표

분광 지표 도출 방안

결과 및 고찰

다분광 인공위성 영상을 이용한 작목 분류 결과

기계학습, 딥러닝 모델에 따른 작목 분류 모델의 성능 차이

분광 지표 도출 방안에 따른 작목 분류 모델의 성능 차이

서 언

최근 전 세계적인 기후변화, 외래 병해충 증가, 연작재배에 의한 수확량 감소 등 농산물 수급의 변동성이 커지고 있음에 따라 작물을 안정적으로 수급하고 유통하기 위한 대책이 필요한 실정이다. 이와 관련하여 농작물의 수급 안정성을 높이기 위한 방법으로 특정 지역의 농작물 품종 분포와 재배 면적을 파악하고, 수확량을 예측하는 방법이 제시된다. 농업 분야에서는 기후, 토양, 고도 등 다양한 환경 요인에 의한 작물 적응성을 평가하기 위해 특정지역의 작목 유형을 분류하고 분포도를 파악하는 방법을 활용한다(Yao et al. 2022). 이러한 평가 방법을 통해 지역별로 생산되는 작물의 다양성과 생산량 등을 파악하여 농작물 생산 및 판매의 산업적 가치를 평가하고, 국가 경제와 수익 창출에 필수적인 기초 자료로 사용할 수 있다.

우리나라는 매년 현지 실측조사와 면접청취 방법을 통해 작물 분류에 대한 조사 결과를 시군 단위의 통계 자료 형태로 제공하고 있다(Ministry of Agriculture, Food and Rural Affairs 2022). 이러한 작목분류 통계정보는 국내 농산물 수급 안정화, 수출 촉진, 농촌 지역의 경제 발전 등 다양한 측면에 영향을 미친다. 하지만 전수 조사 기반 작물 분류 통계 자료는 정확하고 신뢰성 높은 정보를 제공함에도 불구하고, 행정 구역 단위 통계 데이터 형식으로 제공하기 때문에 특정 공간 범위에 대한 세부적인 작목 분포 및 재배 현황을 파악하기 어렵다. 이에, 공간적 범위에 대한 작물의 생산성을 파악하고 관련 농업 자원의 효과적인 계획 및 관리를 위해서는 작물의 세부적인 분포와 유형 분류에 대한 정보가 요구된다(Yao et al. 2022).

이를 위해 원격탐사(Remote Sensing, RS)1)를 기반으로 작목 분류 정보를 파악하고자 하는 다수의 연구가 진행되었다(Sonobe et al. 2018; Ghassemi et al. 2022). 원격탐사 기반의 다분광 영상 처리 기술은 정밀농업의 주요 기술로 기존 전통농업에서 벗어나 빅데이터, 인공지능, 정보 통신 기술(Information Communication Technology, ICT) 등 디지털 기반 농업 전환에 필수적으로 사용된다. Sonobe et al.(2018)은 다분광 인공위성인 Sentinel-2에서 제공하는 10개의 분광 정보를 기반으로 분광 지표를 도출하고 기계학습 모델인 랜덤 포레스트(Random Forest, RF)와 서포트 벡터 머신(Surport Vector Machine, SVM)을 이용하여 분류 모델 간 정확도 평 연구를 수행하였다. 또한, Ghassemi et al.(2022)는 동일한 Sentinel-2 인공위성의 밴드 정보와 분광 지표 등을 기반으로 유럽 전역에 대한 작물 유형을 상세하게 분류한 지도 제작 연구를 수행하였다.

이러한 연구들은 공통적으로 다분광 인공위성 영상이 제공하는 밴드 정보를 기반으로 분광 지표를 도출하고 작목 분류에 영향을 주는 변수를 다차원적으로 활용한다는 특징이 있다. 인공위성 영상이 단일 시기에서 제공하는 밴드 정보는 작목의 엽록소, 카토리노이드, 안토시아닌 지표 등에 민감한 분광 지표를 도출하여 작목 분류 모델 성능에 크게 기여한다(Zhang et al. 2016). 특히, 전술한 연구들에서 사용한 인공위성 이미지는 원격탐사에서 동일한 지점을 찍는 시간 간격인 시간 해상도(Temporal Resolution)에 따라 취득된 시계열 데이터를 입력 데이터로 사용하여 작목의 성장 주기에 따른 공간/시간적 특징을 복합적으로 학습하고 분류 성능을 향상시킨다(Ji et al. 2018).

다만, 상기한 연구들은 공통적으로 작목 분류 모델의 성능에 영향을 미치는 분광 지표를 도출하는 방법론에 대해 해당 연구에 종속적인 방안을 사용하여 작목 분류를 위한 분광 지표의 선택이 분류 모델의 성능에 미치는 영향을 검증하는 데 한계가 있다. 특히, 다분광 인공위성 영상에서 취득하는 밴드 정보를 기반으로 도출 가능한 모든 분광 지표를 사용하여 모델을 개발하거나, 분류 모델의 성능을 최적화하기 위해 학습 모델에 중요한 영향을 미치는 입력 데이터를 최적화하여 도출하는 재귀적 특징 제거(Recursive Feature Elemination, RFE) 방법론을 사용하는 등 분광 지표가 작목 분류 모델에 어떠한 영향을 미치는지 파악하지 못 하였다. 특히, 하이퍼파라미터(Hyperparameter)는 작목 분류에 사용된 분광 지표가 모델에 미치는 영향을 파악하고 검증하기에 미흡한 실정이다. 기계학습과 딥러닝 기반 작목 분류 모델의 품질 개선을 위해서는 정확한 분광 특성 파악과 지표 선정 그리고 모델 정확도 간 비교·분석이 중요하다고 할 수 있다.

이 연구의 목적은 다분광 인공위성 영상을 기반으로 사과, 배 작목의 분광 지표를 도출하고, 주요 분광 지표에 따른 기계학습과 딥러닝 기반 작목 분류 모델의 정확도를 분석하는 데 있다. 연구의 흐름은 다음과 같다. 첫째, 논산시를 대상으로 Sentinel-2 인공위성 영상을 취득하고 작목 분류 모델에 필요한 분광 지표 데이터세트(DataSet)를 구축한다. 둘째, 도출된 분광 지표를 기반으로 작목 분류 모델에 적용하기 위한 주요 분류 지표를 상관 계수(Correlation Coefficients), 상호 정보량(Mutual Information), 분산 분석(Analysis of Variance, ANOVA)으로 구분한 분류 모델을 개발한다. 마지막으로 구분한 분류 지표별 정확도를 비교·분석하여 연구의 시사점을 제시한다.

재료 및 방법

사례 지역과 분석 데이터

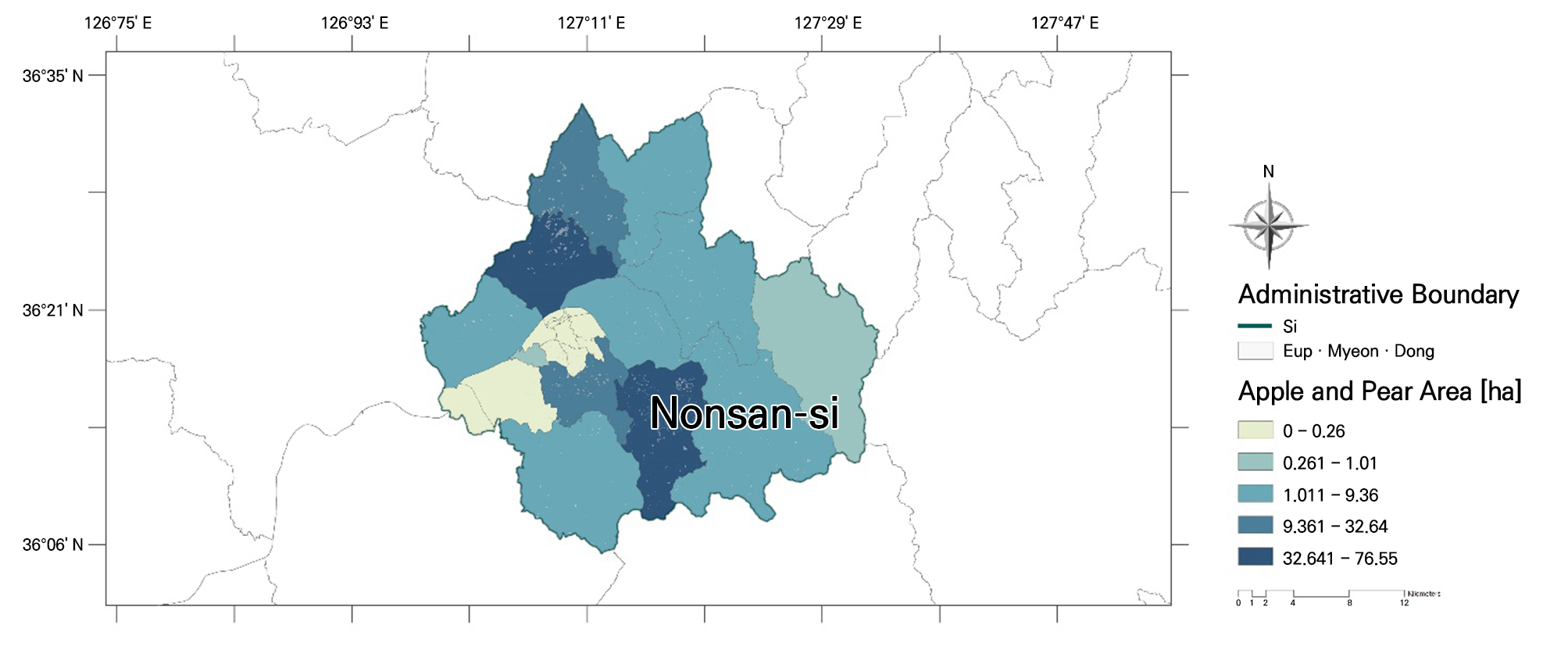

이 연구는 충청남도 논산시를 대상으로 한다. 논산시는 Fig. 1과 같이 2개의 읍, 11개의 면 그리고 11개의 동으로 구성되고 북위 36°04'–36°16'와 동경 126°59'–127°20'에 위치한다(Nonsan City Hall 2023). 특히, 이 연구는 연구 목적에 따라 논산시의 과원을 사과, 배 그리고 기타로 구분하여 데이터세트를 구축하였다. 농업경영체 등록정보 통계 서비스에 따르면 논산시의 사과 과원은 가야곡면(12.33ha), 노성면(7.62ha), 광석면(2.68ha), 부적면(2.18ha) 순으로 나타난다. 그리고 배 과원은 광석면(93.87ha), 가야곡면(29.21ha), 노성면(25.2ha), 은진면(18.07ha) 순으로 분포한다(Ministry of Agriculture, Food and Rural Affairs 2023).

다분광 인공위성 영상을 기반으로 논산시 사과, 배의 식생 지수와 분광 지표를 도출하기 위해 공간정보(Geographic Information)2)와 Sentinel-2 인공위성을 이용하여 데이터세트를 구축하였다. 공간정보는 Table 1과 같이 토지피복지도(Land Cover Map)3), 지적도(Cadastral Map)와 관련된 도형 데이터와 실제 과원 위치 정보를 담고있는 위치 정보를 사용하였다.

Table 1.

Overview of data sources

Ministry of Environment(2023)에서 제공하고 있는 토지피복지도는 Table 2와 같이 토지용도를 코드로 분류하고, 코드별로 정해진 색상 정보에 따라 지도 위에 표시한다. 이 연구에서 사용된 과원 정보는 중분류 코드 240, 세분류 코드 241에 해당한다. 이에 따라, 토지피복지도를 기반으로 과원에 해당하는 도형정보를 추출하고, 지적도의 필지 정보와 조인(Join)하였다. 그리고 논산시청에서 제공받은 실제 사과, 배 과원 주소 데이터를 지오코딩(Geicoding)을 통해 위치 정보로 변환하고 기 구축된 도형정보와 연계하였다.

Table 2.

Land cover classification system for agricultural land

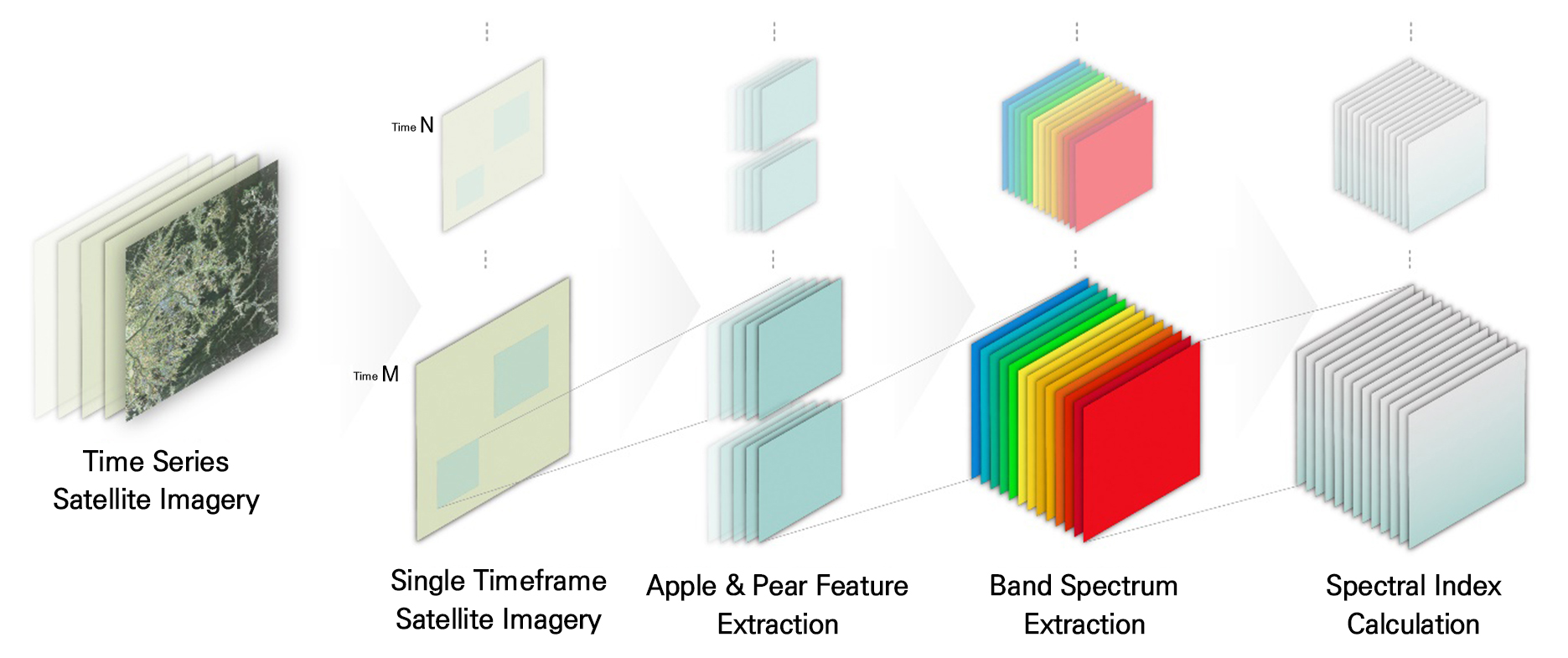

다분광 인공위성 영상은 Fig. 2와 같이 논산시 과원 영역에 구름이 덮여 있을 경우 해당 지역의 분광 지표를 취득하는데 어려움이 있기 때문에 2022년의 3월–6월 그리고 9월 11월에 해당하는 시기의 영상을 복합적으로 사용하였다(Time Series Satellite Imagery). 이후, 공간정보를 통해 취득한 실제 사과, 배, 기타 과원의 도형정보를 개별 시기(Single Timeframe Satellite Imagery)의 인공위성 이미지와 마스킹하여 추출하였다(Apple < Pear Feature Extraction). 이러한 과정을 통해 실제 사과, 배, 기타 과원 위치에 해당하는 평균 밴드 정보를 Table 3과 같이 추출하였다(Band Spectrum Extraction). 마지막으로 Sentinel-2에서 제공하는 주요 10개의 밴드 정보를 기반으로 16개의 분광 지수를 계산하였다(Spectral Index Calculation).

Table 3.

Sentinel-2 band characteristics

다분광 인공위성과 분광 지표

유럽 우주국(European Space Agency, ESA)에서 운영하는 지구관측위성인 Sentinel-2는 타 인공위성과 비교하여 짧은 주기를 기반으로 농업 및 산림 모니터링을 위한 다분광 영상을 제공한다. 이러한 Sentinel-2의 다분광 인공위성 이미지는 Table 3과 같이 비교적 높은 공간 해상도를 기반으로 밴드 정보를 제공하여 광범위한 규모의 식생 지수를 획득하고 농업 모니터링을 지원한다(Segarra et al. 2020). 이 연구는 과학적인 분광 지표 도출과 정확한 사과, 배의 작목 분류를 위해 대기에 대한 보정이 적용된 Sentinel-2A 위성의 Level-2A 자료를 활용하였다.

분광 지표는 주로 작물의 정보를 표현하기 위해 사용되며, 목적에 따라 매우 많은 지표가 존재하고 이를 적절하게 선택하는 것은 중요하다. 이러한 분광지표는 상추 등 작물의 품질 특성을 높은 정밀도로 측정하기 위한 모델 개발에 활용된다(Karki et al. 2024). 특히 식물 내 엽록소의 합량을 추정하기 위한 정규화된 식생지수(Normalized Difference Vegetation Index, NDVI)는 대표적인 지표로 사용되고 있다(Cho et al. 2020). NDVI는 작물의 특성에 따라 반사하는 밴드 정보의 상이한 특징들을 기반으로 계산된다. 이는 주로 다분광 영상을 통해 취득된 작물의 반사값을 기반으로 산출되며, 작물의 특징과 높은 상관관계를 나타낸다는 특징이 있다(Jin and Eklundh 2014). 즉, 작물의 분광 지표는 사과, 배 등 작물의 유형과 해당 작물의 특성을 수치로써 표현하는 일종의 지문(Fingerprint) 역할을 수행한다고 할 수 있다.

분광 지표 도출 방안

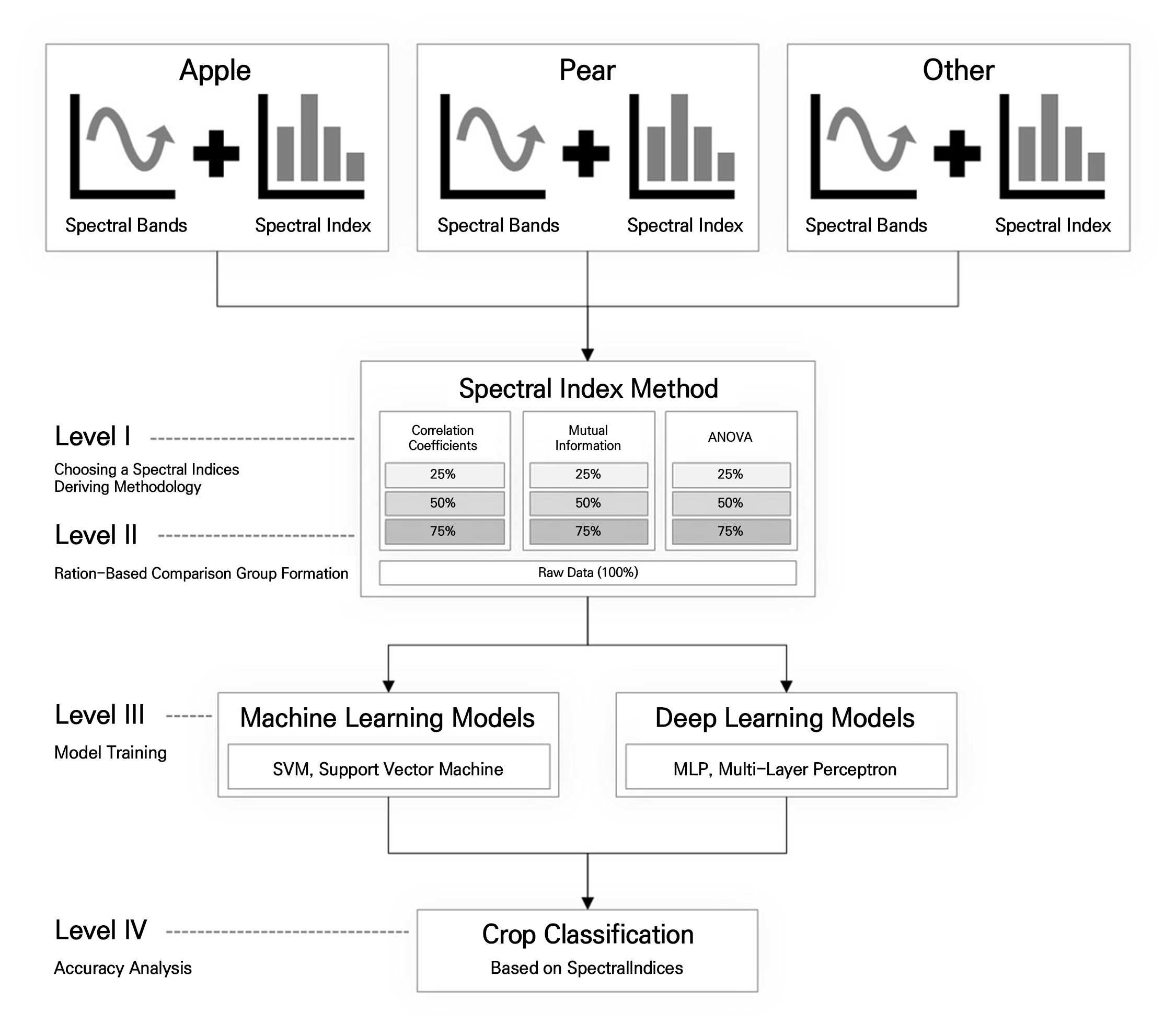

이 연구는 도출된 밴드 정보와 분광 지표를 기반으로 사과, 배 분류 모델을 개발하기 위해 Fig. 3과 같은 작물의 주요 분광 지표 도출 방안을 정립하였다.

우선 Level I과 같이 다분광 인공위성 영상을 기반으로 사과, 배 그리고 기타 작목의 밴드 정보를 추출하고 각 작목의 분광 지표를 도출한다. Level II에서는 주요 분광 지표를 도출하기 위한 기준을 정립한다. 주요 분광 지표를 도출하기 위한 방법론으로는 상관 계수(Correlation Coefficients)4), 상호 정보량(Mutual Information)5) 그리고 분산 분석(Analysis of Variance, ANOVA)6)을 상위 25%, 50%, 75%로 구분하여 수행한다. Level III에서는 작목 분류를 위한 모델로 기계학습 모델인 서포트 벡터 머신(SVM, Support Vector Machine)과 딥러닝 모델인 다층 퍼셉트론(Multi-Layer Perceptron, MLP)을 사용하여, Level II에서 구분한 분광 지표 도출 방안에 따른 모델을 학습한다. 마지막으로 Level IV에서는 분광 지표 도출에 따른 작목 분류 모델의 정확도를 비교하고 정확도가 높은 분광 지표 도출 방법론을 기준으로 작목 분류 결과를 확인한다.

결과 및 고찰

다분광 인공위성 영상을 이용한 작목 분류 결과

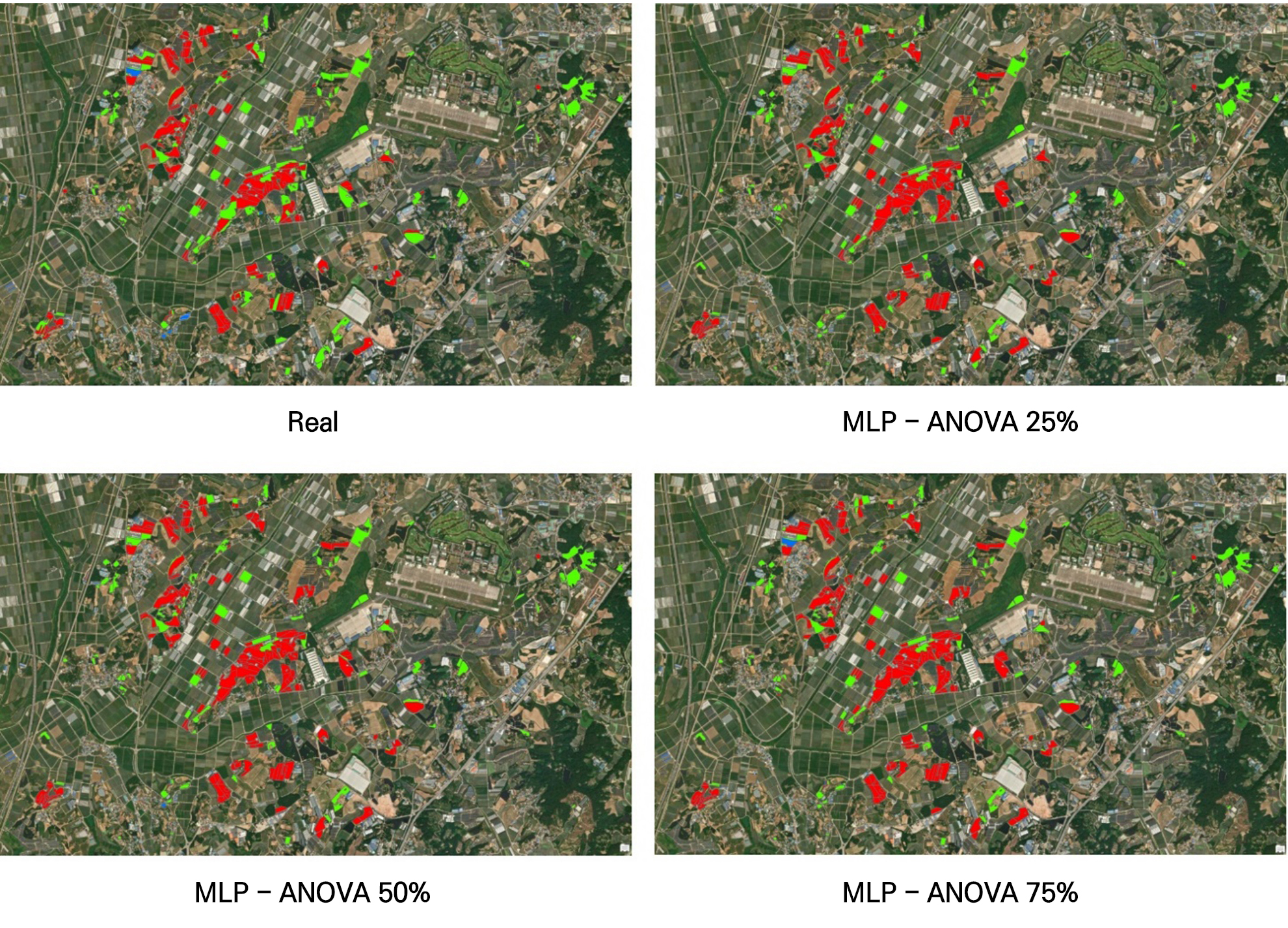

다분광 인공위성 영상을 활용하여 사과와 배 작목의 분광 지표를 도출한 후, 이를 기반으로 기계학습과 딥러닝 모델을 통해 인공위성 영상 내 작목을 분류한 결과는 Fig. 4와 같다. 기계학습 모델인 서포트 벡터 머신(Support Vector Machine, SVM)과 딥러닝 모델인 다층 퍼셉트론(Multi-Layer Perceptron, MLP) 모델 중 이 연구에서 가장 높은 성능을 보인 MLP 모델의 분산 분석(ANOVA) 결과를 Fig. 3의 주요 분광 지표 도출 방안의 Level II에 따라 실제 현황(Real)과 분광 지표를 상위 25%, 50%, 75%로 구분하여 분석한 결과를 비교하여 나타냈다. 분류 모델은 배를 빨강, 사과를 파랑, 그리고 사례 지역 내 사과와 배를 제외한 기타 작목을 초록으로 구분하여 나타낸다. 이는 Sentinel-2 인공위성을 활용한 결과로써 Table 3과 같이 픽셀의 크기로 표현되는 높은 공간 해상도와 파장 범위를 의미하는 분광 해상도를 기반으로 광범위한 농업 지역을 모니터링하는데 유용하다는 점을 강조한 기존 연구와 일치한다(Segarra et al. 2020). 또한, 사과와 배를 분류하기 위해 제시한 Fig. 3의 분광 지표 도출 방안은 Sentinel-2의 밴드 정보를 기반으로 다양한 분광 지수(Spectral Index Calculation)를 계산하고 모델에 반영하여 높은 정확도(R2 = 0.8902)를 도출했다는 점에서, 다분광 인공위성 영상의 분광 지표가 작물의 생리적 특성을 보다 정확하게 반영하고 모니터링한다는 기존 연구 결과와 유사하였다(Jin and Eklundh 2014).

특히, 이 연구는 다분광 인공위성 영상을 활용하여 사과, 배 작목의 주요 분광 지표 도출 방안에 따른 작목 분류 모델의 정확도를 분석하는데 목적이 있다. 기존 선행연구는 딥러닝 모델에 다중 스펙트럼인 빨강(Red), 초록(Green), 파랑(Blue), 근적외선(Near Infrared, NIR)과 이를 활용한 분광 지표인 정규화된 식생지수(Normalized Difference Vegetation Index, NDVI) 그리고 다중 시계열 원격탐사 이미지를 적용하여 분류하였다(Ji et al. 2018). 반면, 이 연구는 NDVI와 같은 특정 분광 지표가 모델에 미치는 영향이 아닌 분광 지표 도출 방안이 작목 분류 모델에 어떠한 영향을 미치는지 파악하기 위해 분산 분석, 상호정보량, 상관 계수에 따라 분광 지표를 구분하고 기계학습과 딥러닝 모델에 적용하였다. 그 결과 Table 4와 같이 Sentinel-2의 주요 10개 밴드 정보를 기반으로 계산 가능한 16개의 분광 지표 조합에 따라 SVM과 MLP 모델의 성능이 세부적으로 다르게 나타나는 것을 확인하였다.

Table 4.

Accuracy comparison of crop classification models based on spectral index derivation

|

Statistical Analysis /AI Model | ANOVAz | MIy | CCx |

RAW (100%) | |||||||||

| G1 | G2 | G3 | G1 | G2 | G3 | G1 | G2 | G3 | |||||

|

MLw DLv | SVMu | 0.6875 | 0.7487 | 0.6756 | 0.6853 | 0.7435 | 0.6642 | 0.6814 | 0.7296 | 0.6629 | 0.6715 | ||

| MLPt | 0.8512 | 0.8654 | 0.8902 | 0.8516 | 0.8587 | 0.8877 | 0.8308 | 0.8451 | 0.8891 | 0.8954 | |||

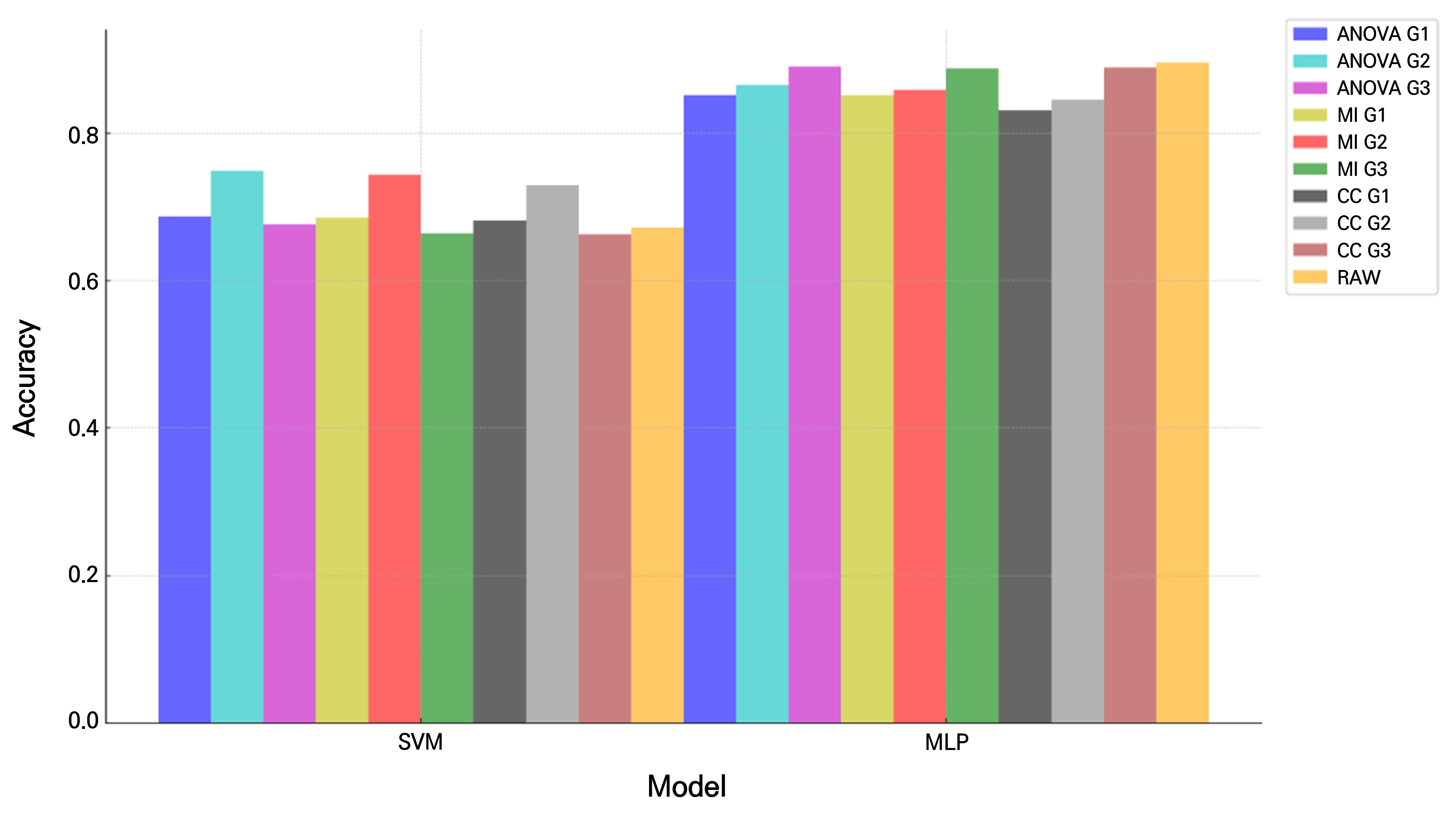

기계학습, 딥러닝 모델에 따른 작목 분류 모델의 성능 차이

모델의 정확도와 관련하여, 유럽 전역을 대상으로 하는 기존 연구는 Sentinel-2 다분광 인공위성 영상과 다중 시계열 데이터를 활용한 SVM 모델을 사용하여 작목을 8개 그룹으로 분류한 결과 82.5%의 정확도를 보였다(Ghassemi et al. 2022). 이러한 선행 연구는 다분광 인공위성 영상과 분광 지표를 활용하여 고정밀 작물 분류 지도를 생성할 수 있는 잠재력을 보여주었다. 이 연구에서 동일한 Sentinel-2 다분광 인공위성 영상을 사용하여 사과, 배, 기타 작목의 분류 정확도를 분석한 결과, SVM 대비(평균 R2 = 0.6950) MLP 모델이(평균 R2 = 0.8665) 모든 지표와 분광 지표 그룹에서 더 높은 정확도를 보였다. 이 연구의 SVM 모델이 선행 연구의 정확도 보다 상대적으로 낮게 나타난 사유는 분류 대상 그룹의 정도 차이로 판단된다(Ghassemi et al. 2022). 선행 연구는 8개의 그룹으로 구분하여 분석한 반면, 이 연구는 사과, 배, 기타 등 3개의 그룹으로 구분하여 분석하였다. 이는 SVM 모델 학습 과정에서 보다 세부적인 작목의 유형별 밴드 정보 및 분광 지표가 반영되지 못했기 때문에 모델 성능에 영향을 미쳤을 것으로 판단된다. 이러한 분석 결과를 향상시키기 위해서는 사과, 배뿐만이 아닌 다양한 작목의 밴드 정보를 취득하고 모델에 반영하기 위한 추가적인 연구가 필요할 것으로 사료된다.

그럼에도 불구하고, 기계학습 모델인 SVM 모델보다 딥러닝 모델인 MLP 모델이 더 뛰어난 성능을 보이는 이유는 기계학습 모델이 주로 벡터(vector)를 사용하여 데이터를 분류하여 밴드 정보와 분광 지표의 복잡한 공간, 분광, 시간적 변화를 효과적으로 포착하지 못하기 때문인 것으로 판단된다. 반면, 딥러닝 모델은 원시 데이터로부터 높은 수준의 데이터 특징을 학습하여 작목의 시간적 변화와 공간적 패턴을 더 정교하게 추정 가능하다(Zhang et al. 2016). 이는 Ji et al.(2018)의 연구에서 활용한 3차원 합성곱 신경망(3D Convolutional Neural Network, 3D CNN) 모델이 작물의 시간적 변화와 공간적 패턴을 더 정교하게 추정하고 뛰어난 성능을 보인 것과 유사하다. 이러한 결과는 딥러닝 모델이 작목의 생장과 관련된 다양한 분광 지표를 학습하고 이를 기반으로 복잡한 패턴을 인식하는 능력이 뛰어나다는 것을 보여준다.

분광 지표 도출 방안에 따른 작목 분류 모델의 성능 차이

분산 분석, 상호정보량, 상관 계수 간 분류 정확도를 분석한 결과로는 분산 분석의 정확도가 SVM, MLP 두 모델 모두 높게 나타났다. 특히, MLP 모델은 분산 분석을 이용한 상위 25% 모델(R2 = 0.8512), 50% 모델(R2 = 0.8654), 75% 모델(R2 = 0. 0.8902)에서 높은 정확도를 보였다(Table 4). 이와 같은 연구 결과는 기존 연구들(Jin and Eklundh 2014; Zhang et al. 2016; Sonobe et al. 2018; Ji et al. 2018; Segarra et al. 2020; Ghassemi et al. 2022)에서 다루지 않은 다양한 분광 지표 간 조합을 실험하여 다분광 영상의 밴드 정보와 각 분광 지표의 조합이 모델에 미치는 영향을 고려했기 때문으로 보인다. 이는 다분광 인공위성 영상의 분광 지표들의 도출 방안 제시와 이들을 활용한 분광 지표별 모델 개발이 다양한 작물의 특성을 포착하고 정확하게 분류하는데 영향을 준다고 할 수 있다. 이는 분산 분석이 작목의 유형에 따라 나타나는 밴드 정보와 분광 지표의 평균 차이를 정확하게 판단하고 분산을 분석하여 이들 간 구분되는 차이를 판단하기에 정확도가 높게 나타난 것으로 판단된다. 또한, 분산 분석을 사용한 도출 방안이 작목 데이터세트 분광 지표 간 차이를 효과적으로 식별하고 데이터 내 중요하지 않은 특성을 제외함으로써 노이즈를 줄이는 것으로 추정된다.

이외에도, 상위 25%, 50%, 75% 간 분류 정확도를 비교한 결과로는 SVM 모델이 Fig. 5와 같이 전반적으로 원본 데이터(R2 = 0.6715)보다 상위 50%의 분광 지표를 사용했을 때 가장 높은 결과를 도출하였다(25% R2 = 0.7487, 50% R2 = 0.7435, 75% R2 = 0.7296). 이는 상대적으로 많은 변수의 분광 지표를 기반으로 모델을 학습하면 모델이 데이터의 노이즈에 과적합될 가능성이 있으며, 불필요한 분광 지표 정보나 노이즈가 분석 모델에 포함될 수 있기 때문으로 판단된다. 또한, 상위 25%의 특성만 사용했을 경우 주요 분광 지표의 일부가 누락되어 분석 모델의 정확도에 영향을 미친 것으로 나타났다.

SVM-ANOVA의 50% 모델이 원본 데이터(Raw)보다 상대적으로 적은 데이터를 사용하여 더 높은 정확도를 나타낸 것은 작목 분류 모델의 최적화에도 의의가 있다. 모델의 최적화는 특히 기계학습 및 딥러닝 모델의 성능을 극대화하고, 데이터 사용의 효율성을 높이며, 예측의 정확성을 향상시키는 데 필수적이다. 다양한 분광 지표를 기반으로 하는 작목 분류 연구에서 모델의 최적화는 Table 4와 같이 모델의 정확도 및 성능에 유의미한 영향을 미친다. 분광 지표 도출 방안에 따라 모델의 불필요한 데이터 요소를 제거하고, 중요한 분광 지표 특징들을 선별함으로써 모델의 복잡성을 줄이면서도 성능을 향상시킬 수 있다. 이는 결과적으로 작목 분류 모델의 분석 시간과 소요 비용을 절감하고, 실용적인 응용 가능성을 높이는 데 기여할 것으로 판단한다.

이에 따라, SVM 모델의 연구 결과에서 확인 가능하듯이 SVM 모델을 사용할 때 상위 50%의 분광 지표만을 선택하는 방법론적 접근은 데이터의 효율적 사용을 통한 계산 비용 절감과 정확도를 높일 것으로 판단된다. 이와 같이, 작목 분류 모델의 분광 지표 선전 방안 모델의 성능 향상뿐만 아니라, 실시간 작물 모니터링과 같은 실용적인 응용에서도 중요한 역할을 수행할 것이다.

이 연구에서 제시하는 분광 지표 도출 방안은 밴드 정보를 기반으로 사과, 배 그리고 기타 작목의 주요 분광 지표를 도출하고 이에 따른 기계학습 및 딥러닝 모델을 제시하였다는 점에서 의의가 있다. 이러한 일련의 프로세스는 사과와 배뿐만이 아닌 다른 작목을 분류하기 위한 모델에도 접목할 수 있을 것으로 판단된다. 즉, 다분광 인공위성 영상에서 작목의 고유한 밴드 정보와 주요 분광 지표를 도출하고 이러한 특징 중에서도 해당 작목의 주요 특징을 적절하게 추출하는 프로세스를 제시했다. 이러한 측면에서 이 연구에서 제시한 사과, 배 작목 분류 모델은 기존 현장 조사를 통해 제공하는 작목 분류 정보 외에도 다분광 영상 취득과 이미지 처리 기술을 기반으로 접근이 불가능한 지역에 대해서도 작목 재배 현황과 분류 분포도를 파악할 수 있을 뿐만 아니라 수확량 예측, 병해충 탐지, 식생 탐지 등 추후 다분광 영상 취득 기술을 이용한 정밀농업 연구를 위한 기초자료로 활용될 수 있을 것이라 판단한다.